- Registrado

- 9 May 2017

- Mensajes

- 29.260

- Calificaciones

- 81.589

- Ubicación

- Buenos Aires - Argentina

El ciberespionaje israelí contado desde dentro

Dov Alfon, que fue miembro del servicio secreto, novela en su debut los entresijos de una unidad secreta de inteligencia militar

El escritor Dov Alfon, en 2016 en la plaza Diaghilev de París, uno de los escenarios de su novela.Assaf Matarasso

El escritor Dov Alfon, en 2016 en la plaza Diaghilev de París, uno de los escenarios de su novela.Assaf Matarasso

Juan Carlos Galindo

Madrid - 06 jun 2020 - 19:30 ART

En noviembre de 1979 un joven israelí a punto de iniciar su servicio militar fue apartado junto a otros 23 reclutas a una sala donde se les comunicó que iban a formar parte de la Unidad 8200, algo que no podían decir a nadie bajo pena de prisión y expulsión. El secretismo era tal que Dov Alfon (Susa, Túnez, 59 años) borró de su mente cualquier comentario a nadie. Hace 12 años, ya como oficial en la reserva, tuvo que pasar un detector de mentiras en el que le preguntaron si se drogaba, si tenía amigos iraníes o si pensaba usar lo que sabía para escribir un libro. Las tres respuestas fueron negativas y superó la prueba, pero al salir se dio cuenta de que no era tan mala idea. Ese es el germen de Una noche muy larga (Salamandra), según cuenta por videoconferencia Alfon desde su acristalado piso de París, ciudad en la que es corresponsal del diario Haaretz.

“No, no puedo hablar de lo que hice en la Unidad 8200”, responde, con la fórmula aprendida, sobre su paso por allí cuando la sección tecnológica del espionaje israelí fue, por ejemplo, responsable de la destrucción del reactor nuclear iraquí en la Operación Ópera. “Mi experiencia me ha servido para hablar del poder y de cómo se maneja. Además, lo increíble es que no ha cambiado tanto. Los principios son los mismos y la unidad empezó muy pronto a tener algunas de las tecnologías que usa todo el mundo ahora. Yo tenía una especie de Google Maps en 1981”, relata.

Una noche muy larga es un thriller de espías que transcurre en 24 horas entre París y varios puntos de Israel, una historia en la que dos miembros de la Unidad 8200 tratan de encontrar antes que ciertos agentes chinos a un soldado israelí que lleva encima información de gran importancia. Mientras, asesinatos, venganzas y traiciones se desarrollan a la par que una carrera de espías en la Red por obtener los datos que den la victoria a su bando.

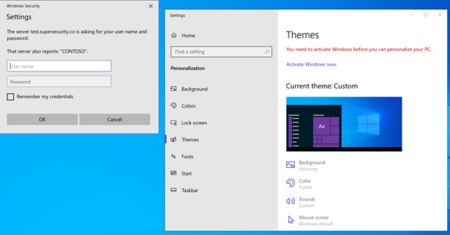

El trasvase entre los servicios de inteligencia y el mundo de la empresa privada en el país con más compañías tecnológicas por habitante es continuo, y es algo que queda muy bien reflejado en el libro. También la censura de los gobiernos democráticos o la invasión de la vida privada de sus ciudadanos en aras de la seguridad. “Intentaba reflejar hasta qué punto nos rastrean tecnológicamente hoy en día. Y no digo solo Rusia o China. Es tu propio Gobierno el que te espía, con agentes muy jóvenes, y no se habla de esto. Por eso pensé que este libro tenía una oportunidad”, explica.

No hay un relato de espías sin un conflicto moral y aquí gira en torno a la lealtad. “Es la esencia de este mundo. Cuando vas a matar a alguien te planteas una serie de cuestiones morales y a quién debes lealtad es una de las principales. ¿A mi país, a mi causa, a unos ideales universales? El lector deberá preguntarse si sería capaz de actuar como mis personajes”.

Tampoco existe una narración del género que se precie, de Ian Fleming a Charles Cumming pasando por John Le Carré, que no tenga un gran enemigo. Aquí es China. “No diría que es una amenaza en la vida real. No. Pero es verdad que es una superpotencia y que si, hablamos de servicios de inteligencia, están mucho mejor equipados y actúan de manera más racional que Rusia y, hoy en día probablemente que Estados Unidos también. Saben lo que hacen y no se les está prestando atención”, analiza.

La estructura de la novela —trama en 24 horas, múltiples escenarios, decenas de personajes— fue una “pesadilla” para un autor novel, pero al final las piezas encajaron y Alfon ya prepara la segunda parte y también la adaptación televisiva de la mano de Keshet, la productora de la serie Homeland. Nunca un detector de mentiras sirvió para tanto en la ficción.

Las dos caras de la verdad

Dov Alfon tuvo un contacto muy distinto con la verdad cuando pasó de espía a periodista y luego a dirigir el diario 'Haaretz' entre 2008 y 2011. En esa época publicó una filtración de documentos del Ejército de Israel que demostraban que falsificaban informes para actuar saltándose las normas en zonas palestinas. La exclusiva generó una gran polémica en su país, pero no en el sentido que Alfon esperaba: “Yo creo que un periodista puede publicar cualquier cosa que sea verdad y que sea de interés público. Otras cuestiones como si es bueno para el país no son relevantes en este caso. En ese sentido fue fácil. Pero la gente tiene miedo de la verdad y el escándalo no fue lo que publicamos, que se olvidó en una semana, sino cómo habíamos conseguido esos informes, una polémica que duró meses”.

elpais.com

elpais.com

Dov Alfon, que fue miembro del servicio secreto, novela en su debut los entresijos de una unidad secreta de inteligencia militar

Juan Carlos Galindo

Madrid - 06 jun 2020 - 19:30 ART

En noviembre de 1979 un joven israelí a punto de iniciar su servicio militar fue apartado junto a otros 23 reclutas a una sala donde se les comunicó que iban a formar parte de la Unidad 8200, algo que no podían decir a nadie bajo pena de prisión y expulsión. El secretismo era tal que Dov Alfon (Susa, Túnez, 59 años) borró de su mente cualquier comentario a nadie. Hace 12 años, ya como oficial en la reserva, tuvo que pasar un detector de mentiras en el que le preguntaron si se drogaba, si tenía amigos iraníes o si pensaba usar lo que sabía para escribir un libro. Las tres respuestas fueron negativas y superó la prueba, pero al salir se dio cuenta de que no era tan mala idea. Ese es el germen de Una noche muy larga (Salamandra), según cuenta por videoconferencia Alfon desde su acristalado piso de París, ciudad en la que es corresponsal del diario Haaretz.

Intentaba reflejar hasta qué punto nos rastrean tecnológicamente. Y no solo Rusia o China. Es tu Gobierno el que te espía y no se habla de esto

“No, no puedo hablar de lo que hice en la Unidad 8200”, responde, con la fórmula aprendida, sobre su paso por allí cuando la sección tecnológica del espionaje israelí fue, por ejemplo, responsable de la destrucción del reactor nuclear iraquí en la Operación Ópera. “Mi experiencia me ha servido para hablar del poder y de cómo se maneja. Además, lo increíble es que no ha cambiado tanto. Los principios son los mismos y la unidad empezó muy pronto a tener algunas de las tecnologías que usa todo el mundo ahora. Yo tenía una especie de Google Maps en 1981”, relata.

Una noche muy larga es un thriller de espías que transcurre en 24 horas entre París y varios puntos de Israel, una historia en la que dos miembros de la Unidad 8200 tratan de encontrar antes que ciertos agentes chinos a un soldado israelí que lleva encima información de gran importancia. Mientras, asesinatos, venganzas y traiciones se desarrollan a la par que una carrera de espías en la Red por obtener los datos que den la victoria a su bando.

El trasvase entre los servicios de inteligencia y el mundo de la empresa privada en el país con más compañías tecnológicas por habitante es continuo, y es algo que queda muy bien reflejado en el libro. También la censura de los gobiernos democráticos o la invasión de la vida privada de sus ciudadanos en aras de la seguridad. “Intentaba reflejar hasta qué punto nos rastrean tecnológicamente hoy en día. Y no digo solo Rusia o China. Es tu propio Gobierno el que te espía, con agentes muy jóvenes, y no se habla de esto. Por eso pensé que este libro tenía una oportunidad”, explica.

El mundo ha cambiado muy rápido y la novela de espías, a pesar de vivir una edad de oro, no lo había hecho del todo. El libro de Alfon, publicado en hebreo en 2016, es el primero que desnuda el mundo del espionaje de comunicaciones, el que se desarrolla con algoritmos y tecnología punta, el que se ha llevado por delante las formas tradicionales de inteligencia. “El 80% de la información valiosa que Israel maneja antes de una operación militar viene de la 8200. Y en el caso de la NSA llega al 90%, solo el 10% es información aportada por agentes de la CIA como en los viejos tiempos. Hay algo tan inhumano en el mundo del espionaje de hoy”, remata riéndose, en una referencia a Zeev Abadi, uno de los dos protagonistas, un tipo que tiene a todo el mundo en contra y que llega a añorar la Guerra Fría, cuando el instinto y las dotes investigadoras valían para algo. Le acompaña Oriana Talmor, una jovencísima sargento de la unidad con mucha chutzpah, la famosa mezcla israelí de desvergüenza y cuestionamiento de las jerarquías, una herramienta esencial para un espía. “La gran mayoría de los protagonistas de las novelas de espías son hombres, pero Israel debe mucho del éxito de su espionaje a las mujeres, por eso quería un personaje femenino fuerte. En Alemania decían que no podían publicarla porque una militar no puede dirigirse así a sus superiores, creían que había un error. Les tuve que explicar que yo había vivido no menos de 10 situaciones similares”.La gran mayoría de los protagonistas de las novelas de espías son hombres, pero Israel debe mucho del éxito de su espionaje a las mujeres

No hay un relato de espías sin un conflicto moral y aquí gira en torno a la lealtad. “Es la esencia de este mundo. Cuando vas a matar a alguien te planteas una serie de cuestiones morales y a quién debes lealtad es una de las principales. ¿A mi país, a mi causa, a unos ideales universales? El lector deberá preguntarse si sería capaz de actuar como mis personajes”.

Tampoco existe una narración del género que se precie, de Ian Fleming a Charles Cumming pasando por John Le Carré, que no tenga un gran enemigo. Aquí es China. “No diría que es una amenaza en la vida real. No. Pero es verdad que es una superpotencia y que si, hablamos de servicios de inteligencia, están mucho mejor equipados y actúan de manera más racional que Rusia y, hoy en día probablemente que Estados Unidos también. Saben lo que hacen y no se les está prestando atención”, analiza.

La estructura de la novela —trama en 24 horas, múltiples escenarios, decenas de personajes— fue una “pesadilla” para un autor novel, pero al final las piezas encajaron y Alfon ya prepara la segunda parte y también la adaptación televisiva de la mano de Keshet, la productora de la serie Homeland. Nunca un detector de mentiras sirvió para tanto en la ficción.

Las dos caras de la verdad

Dov Alfon tuvo un contacto muy distinto con la verdad cuando pasó de espía a periodista y luego a dirigir el diario 'Haaretz' entre 2008 y 2011. En esa época publicó una filtración de documentos del Ejército de Israel que demostraban que falsificaban informes para actuar saltándose las normas en zonas palestinas. La exclusiva generó una gran polémica en su país, pero no en el sentido que Alfon esperaba: “Yo creo que un periodista puede publicar cualquier cosa que sea verdad y que sea de interés público. Otras cuestiones como si es bueno para el país no son relevantes en este caso. En ese sentido fue fácil. Pero la gente tiene miedo de la verdad y el escándalo no fue lo que publicamos, que se olvidó en una semana, sino cómo habíamos conseguido esos informes, una polémica que duró meses”.

El ciberespionaje israelí contado desde dentro

Dov Alfon, que fue miembro del servicio secreto, novela en su debut los entresijos de una unidad secreta de inteligencia militar

:quality(85)//cloudfront-us-east-1.images.arcpublishing.com/infobae/4BDSP5ZYYA35MARYAYGLODQ5FM.jpg)